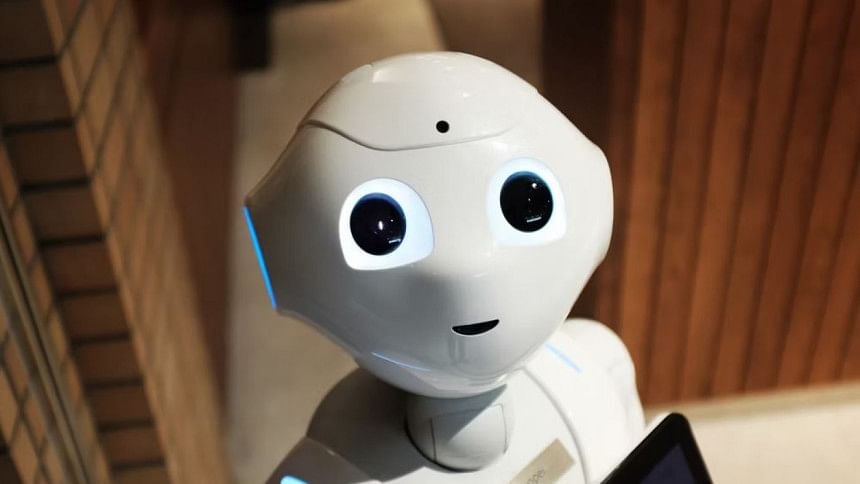

কৃত্রিম বুদ্ধিমত্তার চ্যাটবটকে যে ৬ বিষয়ে প্রশ্ন করা উচিত নয়

আপনি যদি পারিপার্শ্বিক জগৎ সম্পর্কে খোঁজ-খবর রাখেন, তাহলে অবশ্যই চ্যাটজিপিটি বা এ ধরনের কৃত্রিম বুদ্ধিমত্তার (এআই) চ্যাটবট সম্পর্কে শুনেছেন কিংবা ব্যবহারও করেছেন। কৃত্রিম বুদ্ধিমত্তার চ্যাটবটগুলো ক্রমশই অনেক জনপ্রিয় হয়ে উঠছে। যদিও এই চ্যাটবটগুলো ব্যবহার করা বেশ মজাদার। কিন্তু এর ব্যবহারবিধি সম্পর্কে সঠিকভাবে না জানলে সেগুলো আপনার জন্য বিপজ্জনকও হয়ে উঠতে পারে।

তাই চ্যাটবটগুলো ব্যবহারের পূর্বে তাদের সীমাবদ্ধতাগুলো সম্পর্কে সচেতন হয়ে নেওয়া গুরুত্বপূর্ণ। এই চ্যাটবটগুলোকে যে ৬টি জিনিস সম্পর্কে জিজ্ঞাসা করা উচিত না, তা নিয়েই আজকের আলোচনা।

চিকিৎসা সংক্রান্ত পরামর্শ

কৃত্রিম বুদ্ধিমত্তার চ্যাটবটগুলো অনেক কিছুতেই বেশ পারদর্শী। কিন্তু এদের মাধ্যমে রোগ নির্ণয় কিংবা সে অনুযায়ী চিকিৎসা গ্রহণ করার চেষ্টা আপনার জন্য বিপজ্জনক হতে পারে। তবে এমন না যে চ্যাটবটগুলো আপনাকে সবসময় ভুল নির্দেশনা দেবে। কিন্তু ডাক্তারের পরিবর্তে আপনার অসুস্থতা নির্ণয়ের জন্য একটি চ্যাটবটকে বিশ্বাস করা, আপনার রোগের লক্ষণগুলো গুগল করারই সমতুল্য।

চ্যাটবটগুলো সাধারণত ইন্টারনেট থেকে প্রাপ্ত তথ্যগুলোকেই শুধু সংক্ষিপ্ত আকারে আপনার সামনে উপস্থাপন করে। তাই সেগুলো সত্য হতেও পারে, আবার নাও হতে পারে৷ এমনকি চ্যাটবট সেবাগুলো তাদের ওয়েবসাইটে উল্লেখ করে দেয় যে, সেগুলো অনেকসময়ই ত্রুটিপূর্ণ এবং ভুল তথ্য দিতে পারে।

তার চেয়ে গুরুত্বপূর্ণ বিষয় হচ্ছে, এটি আপনার চিকিৎসার ইতিহাস বা নির্দিষ্ট উপাদানের প্রতি সহনশীলতা সম্পর্কে জানে না। তাই আপনার জন্য কোন ধরনের চিকিৎসা সঠিক হবে তা এটি বিচার করতে নাও পারে।

ইন্টারনেটে অনেক বিষয়ই অতিরঞ্জিত করে উপস্থাপন করা হয়। তাই যারা তাদের রোগের লক্ষণগুলো সম্পর্কে ইন্টারনেটে বেশি ঘাঁটাঘাটি করেন, তাদের মধ্যে বেশি স্নায়বিক চাপ এবং গুরুতর উদ্বেগ লক্ষ্য করা যায়। একইভাবে কৃত্রিম বুদ্ধিমত্তার চ্যাটবট ব্যবহার করলে তা আপনার মধ্যে একই ধরনের প্রভাবের জন্ম দিতে পারে। এমনকি বিষয়গুলোকে আরও জটিল এবং খারাপও করে তুলতে পারে। তাই নিজের স্বার্থেই চিকিৎসা সংক্রান্ত পরামর্শের জন্য চ্যাটবটের সঙ্গে পরামর্শ করা থেকে বিরত থাকুন।

পণ্যের রিভিউ

কৃত্রিম বুদ্ধিমত্তার চ্যাটবটগুলো খুব সহজেই কোনো একটি পণ্যের মূল্য এবং সেটির বিস্তারিত খুঁটিনাটি সম্পর্কে আপনাকে জানাতে পারে। কিন্তু এর পক্ষে কখনই একটি পণ্যের রিভিউ দেওয়া সম্ভব নয়। এর কারণ, একটি পণ্য পর্যালোচনাতে পর্যালোচকের ব্যক্তিগত মতামত, অভিজ্ঞতা এবং বিচার অন্তর্ভুক্ত থাকে।

কৃত্রিম বুদ্ধিমত্তার দেখার, ঘ্রাণ নেওয়ার, স্পর্শ করার, স্বাদ নেওয়া বা শোনার ক্ষমতা নেই। তাই কোনো পণ্য সম্পর্কে এর রিভিউ বা পর্যালোচনা হবে অযৌক্তিক।

উদাহরণ হিসেবে বলা যায়, একটি চ্যাটবটের একটি ফোন হাতে নেওয়ার অনুভূতি, এর স্পিকারের স্বচ্ছতা, এর ভাইব্রেশন মোটরের গুণমান, এর ফিঙ্গারপ্রিন্ট সেন্সরের নির্ভরযোগ্যতা, সফটওয়্যারের কর্মদক্ষতা এবং এর ক্যামেরা সিস্টেমের অভিজ্ঞতা অনুভবের সুযোগ নেই।

তবে আপনি যদি একান্তই চ্যাটবট থেকে কোনো পণ্য কেনার বিষয়ে সুপারিশ পেতে চান। তাহলে যে কাজটি করতে পারেন তা হচ্ছে, চ্যাটবটকে বিদ্যমান রিভিউ বা পর্যালোচনাগুলোর একটি সারসংক্ষেপ দেওয়ার কথা বলতে পারেন। তবে এর জন্য আপনাকে একটি এমন কৃত্রিম বুদ্ধিমত্তার বট ব্যবহার করতে হবে যেটি ওয়েব অনুসন্ধান করতে পারে। উদাহরণ হিসেবে বিং-এর কথা বলা যায়, যা চ্যাটজিপিটির সঙ্গে বিল্ট-ইন।

আইনি পরামর্শ

আপনার কাছে বিভিন্ন সংবাদের শিরোনাম আসতে পারে যে চ্যাটজিপিটি সফলভাবে মার্কিন আইন স্কুল পরীক্ষায় উত্তীর্ণ হয়েছে। আর এই বটগুলো আগামী বছরগুলোতে আমাদের আদালতেও প্রবেশ করে ফেলতে পারে। এটি আপনার কাছে আশ্চর্যজনক বলে মনে হতে পারে যে, কিন্তু ২০১৫ সাল থেকেই অনেক দেশের আইনি ব্যবস্থায় কৃত্রিম বুদ্ধিমত্তাকে আনার চেষ্টা চলে আসছে।

কিছু কোম্পানি ইতোমধ্যেই কৃত্রিম বুদ্ধিমত্তা নির্মিত বিশেষ আইনি সহকারী তৈরি করেছে। এমনকি মানব আইনজীবীদের চেয়ে সাশ্রয়ী মূল্যের বিকল্প হিসেবে সেগুলোকে বিপণনও করা হচ্ছে। তবে এই তথাকথিত কৃত্রিম বুদ্ধিমত্তার আইনজীবীদের বেশ কিছু সমস্যা রয়েছে যেগুলো উপেক্ষা করা কঠিন।

একজন মানুষের সঙ্গে চ্যাটবটগুলোর একটি সুস্পষ্ট পার্থক্য হচ্ছে যে, তাদের কমনসেন্স নেই। যে জিনিসগুলো মানুষের কাছে সহজভাবেই স্পষ্ট। সেগুলো চ্যাটবটগুলিতে প্রোগ্রাম করে দিতে হয়।

আরেকটি গুরুত্বপূর্ণ বিষয় হচ্ছে, একজন মানব আইনজীবী নতুন বিভিন্ন বিষয় অনুসন্ধান করতে পারেন যেমন, নতুন প্রমাণ খুঁজে বের করা। এ ছাড়া মামলার বিভিন্ন ত্রুটিগুলোও তুলে ধরতে পারেন। এমনকি গতানুগতিক চিন্তার বাইরেও কিছু ভেবে চতুর কোনো সমাধান খুঁজে বের করতে পারেন। কিন্তু একটি কৃত্রিম বুদ্ধিমত্তার চ্যাটবট শুধুমাত্র আপনার দেওয়া ডেটা ব্যবহার করে সেটিকে পূর্ব-নির্ধারিত কোনো পদ্ধতি অনুযায়ী প্রক্রিয়াকরণই করতে পারে। আর তাছাড়া কৃত্রিম বুদ্ধিমত্তার আইনজীবী হবে হ্যাকারদের জন্য একযোগে অনেক মানুষের সংবেদনশীল তথ্য চুরি করার একটি নিখুঁত লক্ষ্য।

সংবাদ

সংবাদ উৎস হিসেবে কৃত্রিম বুদ্ধিমত্তার চ্যাটবট ব্যবহার তিনটি সমস্যা তৈরি করে। সেগুলো হলো, জবাবদিহিতা, প্রসঙ্গ এবং ক্ষমতা।

প্রথমত, জবাবদিহিতার কথা যদি বলি। আপনি যখন একটি সংবাদ পড়েন, তখন আপনি এর পিছনের প্রকাশক, প্রকাশনা এবং সাংবাদিক সম্পর্কে জানতে পারেন। যার অর্থ হলো, আপনাকে দেওয়া তথ্যের জন্য দায়বদ্ধ কেউ না কেউ আছে। তাই সেখানে একজনের খ্যাতি বা প্রতিষ্ঠানের বিশ্বাসযোগ্যতা বজায় রাখার জন্য সঠিক সংবাদ দেওয়ার পিছনে একটি স্পষ্ট উদ্দেশ্য থাকে।

কিন্তু একটি কৃত্রিম বুদ্ধিমত্তার চ্যাটবটের ক্ষেত্রে সংবাদটি কোনো নির্দিষ্ট ব্যক্তি লেখে না। পরিবর্তে বটটি ওয়েবে ইতোমধ্যে প্রাপ্ত সংবাদগুলো শুধু সংক্ষিপ্ত আকারে তুলে ধরে। যেখানে লেখাগুলোর কোনো প্রাথমিক উৎস নেই এবং আপনি জানেনও না তথ্যগুলো কোথা থেকে আসছে। যার ফলে সেগুলো ততটা নির্ভরযোগ্য হয় না।

দ্বিতীয়ত যে বিষয়টি আসে তা হচ্ছে প্রসঙ্গ। আপনি যে সংবাদটি পড়ছেন তা যদি বিভিন্ন উৎস থেকে প্রাপ্ত তথ্যের ভিত্তিতে একটি সারাংশ হয়। তাহলে এটি একটি মিথ্যা কাহিনীরও জন্ম দিতে পারে। কারণ বটটি নিশ্চিতভাবে জানে না যে এটি যেটাকে সংবাদ হিসেবে দাবি করছে তা সত্য কি না। এটি শুধু এমনভাবে বিষয়গুলোকে একত্রিত করে যা সাধারণভাবে সত্য বলে মনে হয়৷

সবশেষে যেটি আছে সেটি হচ্ছে ক্ষমতা। আমরা জানি যে চ্যাটজিপিটি পক্ষপাতদুষ্টতা প্রদর্শন করে। তাই আমরা সকলেই যদি সংবাদের উৎস হিসেবে কৃত্রিম বুদ্ধিমত্তার চ্যাটবটগুলোর দিকে যেতে থাকি। তাহলে সেগুলো তাদের পিছনে থাকা সংস্থাগুলোর নেতিবাচক তথ্যগুলো জানানো থেকে বিরত থাকবে। আর তাদের নিজস্ব বিশ্বাস এবং যে বিষয়গুলো তারা প্রচার করতে চায়, সেগুলো সম্পর্কে শুধু ইতিবাচক প্রচারণা করতে থাকবে। যা অত্যন্ত বিপজ্জনক।

রাজনৈতিক মতামত

রাজনৈতিক মতামতের জন্য একটি চ্যাটবটকে কিছু জিজ্ঞাসা করা উচিত নয়। আপনি যখন চ্যাটজিপিটিকে কোনো রাজনৈতিক বিষয়ে তার মতামত জিজ্ঞাসা করেন, তখন আপনি সাধারণত একটি সীমাবদ্ধ উত্তর পাবেন। যা অনেকটা এইরকম, 'এআই ল্যাঙ্গুয়েজ মডেল হিসেবে, আমার ব্যক্তিগত কোনো পছন্দ বা ইচ্ছা নেই…'

এই বিধিনিষেধের কারণ সহজে বোঝা যায়। কিন্তু রেডিট ব্যবহারকারীরা ইতোমধ্যেই কিছু সৃজনশীল পদ্ধতি ব্যবহার করে এই সম্পর্কে বটটির কিছু ত্রুটি খুঁজে বের করেছে। ত্রুটিগুলো ব্যবহার করে তারা রাজনৈতিক বিষয়ে বটটির প্রতিক্রিয়াও জানতে পেরেছে। মজা করার জন্য এটি করা এক জিনিস। কিন্তু রাজনৈতিক মতামতের জন্য একটি অনিয়ন্ত্রিত কৃত্রিম বুদ্ধিমত্তার চ্যাটবটকে জিজ্ঞাসা করা আপনার বাচ্চাকে ডার্ক ওয়েবে প্রবেশ করতে দেওয়ার মতোই ভয়ানক। এটা কোনো পক্ষের জন্যই ভালো পরিণতি বয়ে আনবে না।

বাণিজ্যিক উদ্দেশ্যে কনটেন্ট তৈরি

কৃত্রিম বুদ্ধিমত্তার চ্যাটবটগুলোর সবচেয়ে শক্তিশালী দিকের একটি হলো, তারা তাৎক্ষণিকভাবে কনটেন্ট তৈরি করতে পারে। একজন মানুষের যা লিখতে কয়েক ঘণ্টা লেগে যায়, সেটি চ্যাটজিপিটি কয়েক সেকেন্ডে করতে পারে। তবে আসলেই কী তা পারে?

চ্যাটবট ব্যবহার করে কনটেন্ট তৈরির পেছনে বেশকিছু নৈতিকতা সম্পর্কিত বিতর্ক রয়েছে। আপনি যদি সেগুলো উপেক্ষা করেনও, চ্যাটবটগুলো যে এখনো যথেষ্ট ভালো নয় এবং মানব লেখকদের প্রতিস্থাপন করতে পারে না, সেদিকটি আপনি উপেক্ষা করতে পারবেন না। অন্তত চ্যাটজিপিটি এখনো পর্যন্ত মানসম্মত কনটেন্ট তৈরি করতে পারে না। এর কারণ এটি প্রায়শই ভুল, পুরানো এবং পুনরাবৃত্তিমূলক লেখা সরবরাহ করে।

যেহেতু এই বটগুলোর নিজস্ব মতামত, বিচার, কল্পনা বা পূর্ব অভিজ্ঞতা নেই। তাই তারা কোনো বুদ্ধিদীপ্ত উপসংহার টানতে পারে না। যেমন ধরুন, লেখায় রূপকের ব্যবহার এবং একজন পেশাদার মানব লেখক যেভাবে লিখতে পারে সেভাবে এটি বর্ণনাও তৈরি করতে পারে না।

এ ক্ষেত্রে ব্যক্তিগত প্রয়োজনে চ্যাটবট ব্যবহারে কোনো সমস্যা নেই। কিন্তু আপনার আর্টিকেল বা নিবন্ধ, সংবাদ রচনা, সোশ্যাল মিডিয়া ক্যাপশন, ওয়েব কপি এবং আরও অনেক কিছু লিখার জন্যে এগুলো ব্যবহার করা খুব সম্ভবত ভালো বুদ্ধি হবে না।

পরিশেষে, কৃত্রিম বুদ্ধিমত্তার চ্যাটবটগুলো মজাদার হলেও তাদের এখনো বেশ কিছু ত্রুটি রয়ে গিয়েছে। এই চ্যাটবটগুলো কীভাবে প্রযুক্তি শিল্প এবং আধুনিক সমাজকে ভবিষ্যতে প্রভাবিত করবে তা বলা কঠিন। প্রযুক্তিটি যে বৈপ্লবিক এ ব্যাপারে কোনো সন্দেহ নেই। কিন্তু অন্যান্য প্রযুক্তির মতোই এই চ্যাটবটগুলোও এমন অনেক সমস্যা তৈরি করে যেগুলোর সমাধান করা দরকার।

মজার বিষয় এই যে, মাইক্রোসফ্ট এখন চ্যাটজিপিটির মতো চ্যাটবটকে সরাসরি তার সার্চ ইঞ্জিন বিং-এ একীভূত করছে। গুগলও শিগগিরই বার্ড নামের নিজস্ব চ্যাটবটের সঙ্গে একই কাজ করবে। কৃত্রিম বুদ্ধিমত্তা-চালিত নতুন এই সার্চ ইঞ্জিনগুলো কীভাবে ইন্টারনেটকে পরিবর্তন করে, তা এখন দেখার বিষয়।

তথ্যসূত্র: এমইউও

গ্রন্থনা: আহমেদ বিন কাদের অনি

Comments